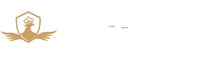

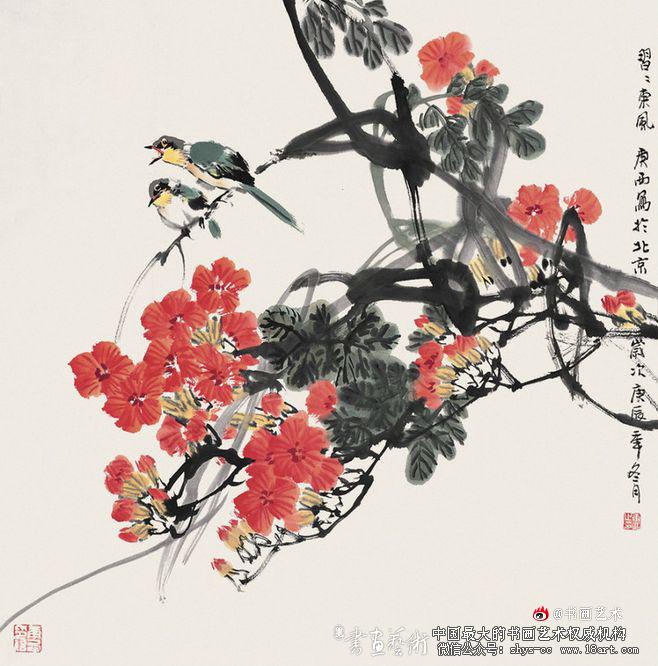

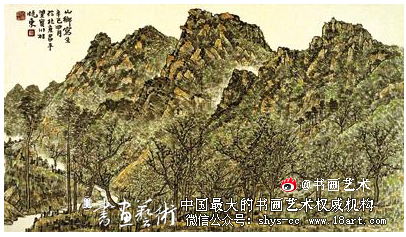

书画展览:徐雪村和他的《溪山访友图》长卷

大家好,产品经理思维模型「阿里产品经理能力模型」很多人还不知道,现在让我们一起来看看吧!

编辑导语:AI产品经理对各方面能力要求都相对较高,本篇文章作者分享了AI产品经理能力模型的重点素质——人文素养和灵魂境界,讲述了该能力的重要性,一起来学习一下。

本文是我第一次正式详述“人文素养和灵魂境界”对于AI产品经理的意义到底在哪里,摘自《AI产品经理的实操手册(2021版)》的1.1.3.3节。

在AI产品经理的能力模型中,我最想提的差异化关键点,就是“人文素养和灵魂境界”。

一、为什么“人文素养和灵魂境界”非常重要1. “人文素养和灵魂境界”如何影响AI产品设计例1:面对一个具体的AI场景,可能会需要体系化的文科知识背景。

1)亚马逊的Alexa:

为了让 Alexa 拥有「人」的性格,亚马逊找了很多女性来做性格塑造:

Alexa 的原始回应组织:由拥有创意写作硕士学位的米歇尔.里根.兰森负责;回应趋近消费者的期望:由专门从事人格科学研究的心理学毕业生法拉赫.休斯顿负责;另外,米歇尔.里根.兰森手下还有一大帮剧作家、诗人、小说家和音乐家,他们每一周的「出品」都会被整合到 Alexa 的人格设定里面去。2)伦理学:在养老院里,有2个老人,一个要看新闻台,一个要看体育台,机器人该怎么办?

3)心理学:AI机器人被用户给教坏了(有种族歧视、脏话等等),怎么解决?心理学上,小孩子会有“依恋对象”(比如妈妈),在被教育提升时,她说的话占绝对领先的权重(比如90%)。

所以,也可以设定某个群体/个体的用户,对某个具体的AI机器人有更大的影响力权重。

例2:AI机器人,应该是“有趣”还是“有用”?

大家知道,作为行业内知名度比较高的2个AI机器人,小冰和度秘曾经的定位重心是不同的(现在已经本质上不一样了)。

前者最开始主要是“有趣”(先抓住用户,再提供更多价值),后者主要是“有用”(能解决实际用户问题的前提下,也会优化更友好的用户交互体验)。

这2个方向,不能说对错,但至少,如果作为其设计者/AI产品经理,首先得有明确的个人认知,否则容易跟着别人的想法变,就没法做事了。

例3:做AI产品设计时(特别是机器人相关产品),能否只重点考虑理性功能/价值,而部分忽略感性功能/价值?

在《AI产品经理的实操手册(2021版)》的1.1.3.1小节中,我提到过“大型机械臂”和“儿童机器人”的案例。

其实是希望大家能知道,对于AI/机器人产品,“必然”会带来感性角度的用户体验,而且这不是以AI产品经理自身的意志为转移的!

也就是说,一旦AI产品经理没考虑感性角度的用户体验问题,很可能会给用户带来感性伤害。

这方面,最经典的一个概念就是“恐怖谷(Uncanny Valley)”。

“恐怖谷”理论,最早是于1970年由日本机器人专家森政弘)提出的:当机器人与人类的相似度极低(如上图的“工业机器人”)时,人们对它没有太多的情感反应。

当这些非人的物体开始被赋予一些人类的特征,在外形和动作上同人类逐渐接近时(如上图的“人形机器人”),人们对它的亲近感和好感度会逐渐增加。

但当它与人类相像超过一定程度,人们对它的好感反而会下降,呈现一个情感反应的低谷,即“恐怖谷”。

当它与人类的相似度继续上升,人们对它的好感会再次回到正面。

日本机器人学者石黑浩,就制作了一个和他一样长相的机器人(见下图),是不是有点恐怖呢(如何区分谁是机器人?看眼睛)?

多说一点,如何避免跌入“恐怖谷”呢?

行业内,规避恐怖谷效应的策略主要有两类:

一类是将人物特征“非人化/卡通化”,使其不像真人,从而保持在恐怖谷左侧的曲线上。Pixar工作室的作品多采用这个策略,比如2004年的电影《超人总动员》。另一类策略则是从真人入手,通过动作表情捕捉反向生成动画角色,使角色极度像真人,从而“跳过”恐怖谷到达右侧的曲线上。比如电影《阿凡达》中的潘多拉星球人,还比如电影《本杰明巴顿奇事》里老年Brad Pitt的角色塑造——老年婴儿Brad Pitt是通过对Brad Pitt真人捕捉附加到CG版Brad Pitt上实现的,CG直接刻画真人也达到了非常高的水平,可以说是电影CG特效的巅峰之作(更多信息可参考文章《诡异的恐怖谷效应》)。电影《阿凡达》

电影《本杰明巴顿奇事》

正如巨著《哥德尔、埃舍尔、巴赫:集异壁之大成》(Godel, Escher, Bach: An Eternal Golden Braid,简称GEB)的作者侯世达(Douglas Hofstader)所说:

在这些例子之上,我个人真正想表达的是:

2. 对“人文素养和灵魂境界是否重要”,3位AI产品经理的实际感受和回应

AI产品经理-甲(刚转型成AI产品经理3个月,初级职位):互联网产品经理也需要人文素养,为什么要特别提出这点?AI产品经理-乙(转型成AI产品经理已24个月):AI产品经理,需要具备的能力素质有很多项,比如了解AI技术边界、有成本意识、有人文素养。AI产品经理-丙(刚转型AI产品经理3个月,但在负责整个事业线):AI产品经理和互联网产品经理相比,能力要求方面,最大的不同是什么?只说一点——“人文素养”。从以上3个真实案例中,对比感受出:

刚转型AI产品经理不久的初级PM,由于能力经验和负责事务的level相对初级,对“人文素养和灵魂境界”并没有特别的感触。转型AI产品经理已相对熟练的PM同学,正开始对“人文素养和灵魂境界”有所重视,但还只是把她当作能力素质项之一来看待。而对于需要站在最高角度看待AI产品的高级PM来说,即使转型AI的时间较短,但由于综合能力视野更强,能很快的发现“人文素养和灵魂境界”可能是对AI产品用户体验影响最大的根本素质项。某种意义上说,能力模型的意义是,决定了我们工作输出价值的上限和下限。

比如,产品经理的常规能力要求、AI相关知识能力以及垂直行业认知等能力项,决定了我们将来工作产出和个人成就的下限。

但“人文素养和灵魂境界”,将会决定我们将来工作产出和个人成就的上限。

也就是说,如果你只是想成为普通的AI产品经理,可以忽略“人文素养和灵魂境界”的提升。

但如果你想成为TOP 5%、甚至TOP 1%的AI产品经理,就一定不能忽视这个方面了。

3. “人文素养和灵魂境界”,对AI产品经理的人生质量也会有影响有一个可怕的现实,可能很多人并未察觉:我们作为AI产品经理从业者,工作中必然会需要去设计AI机器人的所思/所想/所为,潜移默化的,我们有可能会在“模拟AI机器人”的过程中,让自己变得越来越像机器人。

有2个相关的现象:

很多长年使用电脑/手机等电子产品的人群,比如超过35岁的互联网从业者,面部肌肉会非常僵硬,看似已经部分的失去了“做表情”的能力,甚至夸张的说,失去了对“情感”的感知和表达的能力。有些朋友发现一个有点奇怪的现象:本以为AI产品经理会更活跃/外向一些,但很多AI产品经理同学,表现得过于内敛、缺乏激情或者打动人的闪光点。就像某位大佬说:我不担心机器会变得像人类,我反而担心人类会变得像机器一样(没有情感)。

也就是说,如果我们有过多的“逻辑性”和“思维束缚”,但缺乏“人文素养和灵魂境界”方面的内涵,可能会造成一个非常严重的后果——让我们自己的人生(家庭/生活),最终都不够幸福。

至少不是我们美好愿景所期望的那样——这真的不是我们想看到的结果。

二、如何提高“人文素养和灵魂境界”“人文素养和灵魂境界”,不是一朝一夕能速成的,最重要的,是多和自己身边“正心诚意”、靠谱的牛人互动学习,潜移默化的提升。

另外,每周日,我会在知识星球“AI产品经理大本营”里分享一些相对超越性的理念或心法,称作“周日换频道”系列文章。

这些内容,不一定适合每个人,但希望能激发大家自己的思想和灵感。

该系列的过往文章,可见《AI产品经理的实操手册(2021版)》的“第五章 个人成长”。

三、AI产品经理的“人文素养和灵魂境界”,是否有一定的评判标准这是某个社群同学曾提出的问题;这里,只是说下我的个人认知,供大家参考。

1. 是否能有自己的感性认知?(涉及价值观;有思想源头)类似前文提到的AI机器人(小冰vs 度秘)的例子,两者定位重心是不同的,“有趣”或“有用”,都是可以选择的方向。

这里有点涉及每个人的不同价值观,不能说哪个一定对或错,但至少,如果作为其设计者/AI产品经理,首先得有自己的明确认知。

不过,需要注意的是,这种涉及价值观的感性认知,应该是有其思想源头的,不论是东方的儒释道,还是西方的某些思想,都可以。

但最好不是“我就是这么认为的”这种空中楼阁式的论断。

2. 有了自己的感性认知方向之后,能否有独到的insight什么叫“独到的insight”?

就像我经常说的,是否有跟主流观点相反的、或者更深一层的认知(英文表述叫unpopular opinion)?

比如,提到足球运动员,可能大众常规认知会觉得他们是头脑简单、四肢发达的肌肉男。

但是,世界顶级足球运动员齐达内就曾说,“足球是一项脑力运动”。

因为他们需要不断的观察场上形势(比如哪里有传球空档)、队友和对方球员的动向等等,运动能力其实是实践他们脑力判断的工具。

还比如,业内对于AI聊天机器人产品的衡量指标,一般首先会想到(沿用)小冰首先提出的“CPS”概念(Conversations Per Session,即一次完整聊天期间的连续对话轮次)。

个人很早就分享过,在聊天机器人领域早期,用CPS来驱动产品技术优化是可以的。

但是,要真正商业化落地,CPS是不够的,比如,如果某款儿童聊天机器人(不论实体或虚拟)通过5轮(对话)交互,就能引导一个小孩调整某个不良行为习惯。

为什么一定要用更多的交互次数呢?

也就是说,最好还是应该从效果角度出发,而不能为了交互次数而交互次数。

这类“跟主流观点相反的、或者更深一层的认知”,可能并不是100%正确,或者未来被他人或自己推翻。

但是,这都不会掩盖其自身的价值。

3. 有了独到insight之后,是否能将宏观、抽象的认知,细化落地到具体的AI产品调性和体验feature设计

比如,“人工智能与法律”听起来是一个非常宽泛、不具体的话题领域。

但是,我在文章《“人工智能与法律”对AI产品经理有何实际借鉴意义》中,基于前面3小节的input和铺垫:

案例 | AI应用时面临的法律问题和风险;现状 | 各国对AI法律政策问题的探索;未来 | AI可能如何影响法律。最终细化到具体的产品feature层面,详见“四、落地 | 以上内容对AI产品经理有何实际借鉴意义”中的“4、产品体验细节设计”,比如:

充分考虑女性、儿童、残疾人、少数族群等易被忽视群体的利益,并对道德和法律的极端情况设置特别的判断规则。特别是聊天对话类产品。体验流程中,如果涉及隐私,需要“明确提醒用户并征得用户同意”,以及“告知用户收集XX隐私信息的期限和方式”,而且,用户有权(有操作入口)拒绝企业对其进行画像等自动化决策(即,不能像Facebook那样,先斩后奏,让用户先使用、然后才能关闭相关功能)。以上AI产品经理“人文素养和灵魂境界”的3条评判标准,虽然不一定全面或正确,但应该是可供大家实操/check的。

最后多分享一点,所谓评判标准,其实还是“仁者见仁智者见智”的事情——具备“仁”的人,才能够看到别人身上的“仁”。

具备“智”的人,才能够看到别人身上的“智”。

也就是说,你有什么,你才能看到什么。

#专栏作家#hanniman,人人都是产品经理专栏作家,前图灵机器人-人才战略官/AI产品经理,前腾讯产品经理,9年AI背景,12年互联网经验;关注人机交互(特别是语音交互)在手机、机器人、智能汽车、智能家居、AR/VR等前沿场景的可行性和产品体验;擅长对创业团队管理、个人成长提出实战型的建议方案;知乎/简书/微博帐号,均为hanniman。

本文原创发布于人人都是产品经理,未经许可,不得转载。

题图来自Unsplash,基于CC0协议。